Don’t worry about th4t (th3 titl&), ci vedete benissimo: ma Meta ha deciso di trasformare Instagram e Facebook in una tavola optometrica, sì, proprio quella che solitamente trovate dall’oculista, appesa al muro, con lettere e numeri combinati a caso. Da qualche tempo, infatti, sulla parete virtuale dei social si leggono paroline strane tipo s3ss0, dr0gh3 o rock&roll. Mi scusi dottor Dury, ci vedo bene? 15 decimi, come lo shadowban. Wikipedia (che di occhio ne ha) lo definisce più o meno così:

Shadowban

(letteralmente «divieto ombra») è un termine utilizzato per riferirsi a un’azione di moderazione che consente di nascondere un determinato utente da una comunità online, oppure di rendere invisibili i contenuti da lui pubblicati ad altri utenti.

Attenzione: non è un ban vero e proprio, come quando pubblichi mezzo capezzolo in penombra, che potrebbe quasi sembrare l’occhio di Sauron e Meta ti dice “Attenzione, questo contenuto minaccia gravemente la nostra comunità maschio-bianca-cisessuale”. Un messaggio e uno stratagemma molto subdoli con cui i network riducono la visibilità di quei contenuti borderline che non violano esplicitamente le policy, ma che potrebbero infastidire alcuni utenti (secondo l’opinione dell’algoritmo, chiaro). E ancora peggio, non te lo dicono: tutto avviene nell’ombra.

M3glio cøsì?

Ok, ma allora come ce ne siamo accorti? C’è stato un casus belli vero e proprio: la guerra in Palestina. In pratica, molti creator e pagine di informazione hanno notato un netto calo delle visualizzazioni per tutti i contenuti pubblicati sulla guerra. Qualcosa di simile per tutti gli altri post, reel o storie sul mondo della sessualità o delle sostanze stupefacenti, che venivano eclissati dall’algoritmo perché giudicati pericolosi – anche quando si tratta di semplice informazione.

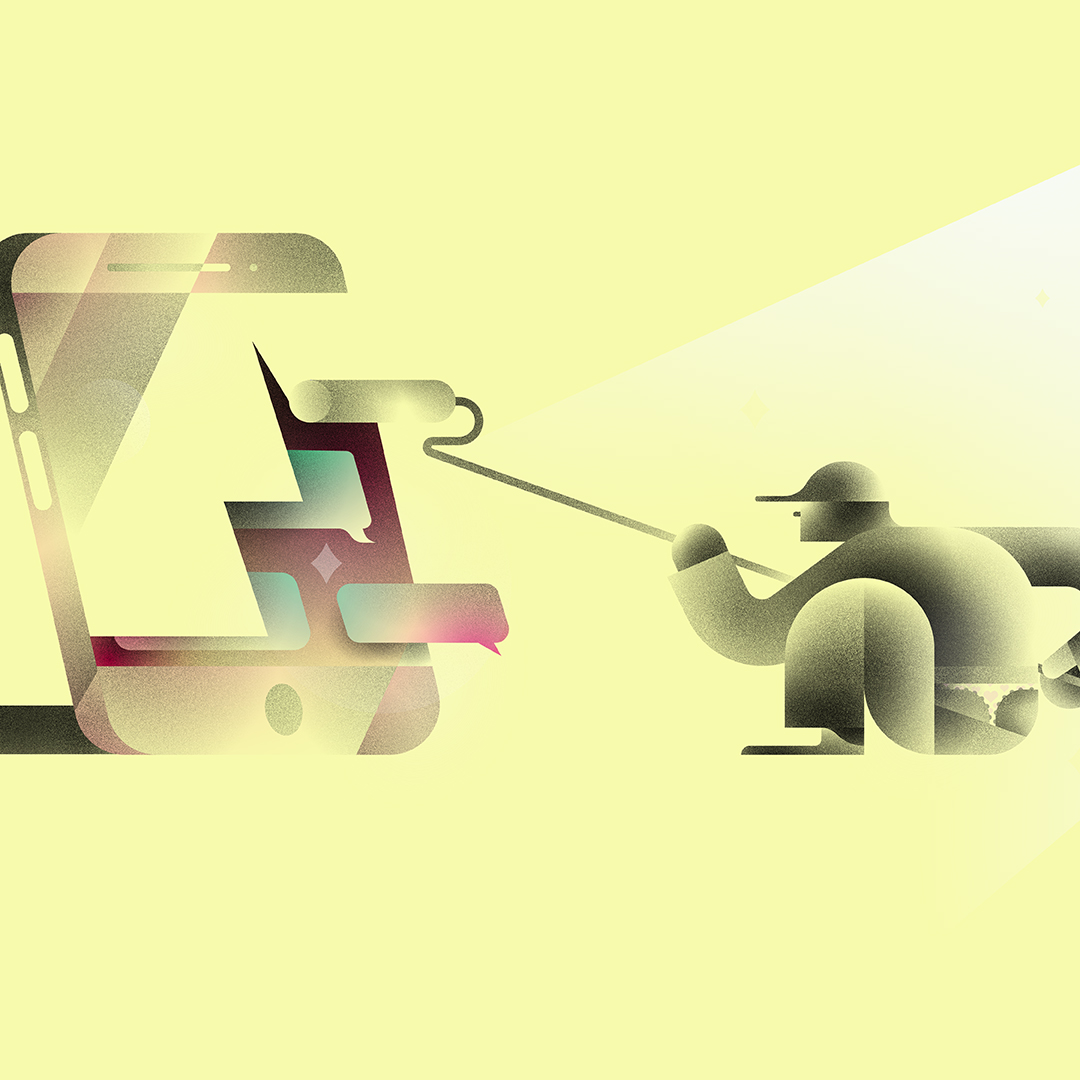

Così è nata un’idea stravagante, che neanche il migliore Dan Brown sarebbe mai riuscito a concepire: codificare un linguaggio ad hoc per eludere lo shadowban. Per farlo, non abbiamo neppure dovuto scomodare Alan Turing, abbiamo solo usato quello che continua a caratterizzare l’essere umano: l’immaginazione e un po’ di sano sgamo. E a quanto pare, sappiamo stare al mondo – e al gioco – perché l’algoritmo non riesce a identificare ‘H4m4s’ e ‘Hamas’, ‘s3ss0’ e ‘sesso’. Povero ban, ci fa quasi tenerezza.

Ma anche no.

Insomma, pare che il ban di Meta agisca in due modi: quando il contenuto viola esplicitamente le policy (blasfemia, incitamento alla violenza, bullismo etc), lo blocca e ammonisce l’utente; quando il contenuto invece è dubbio, cioè non si capisce bene se possa nuocere o meno alla community, è molto probabile che il sistema nervoso centrale lanci il segnale di attacco allo shadowban, che parte in quarta temendo di essere licenziato come gli 11.000 dipendenti di Zuckerberg l’anno scorso. Ecco, questo secondo meccanismo ci fa capire che sui social esiste una sorta di zona grigia, un purgatorio in cui le piattaforme nascondono quello che preferiscono eclissare. Come la polvere sotto al tappeto. Lo si legge bene in un recente comunicato di Meta, tanto elegante quanto confusionario: «l’obiettivo di Meta è di permettere alle persone di esprimersi liberamente, rimuovendo contenuti pericolosi». Un ossimoro leggero-leggero, come libera censura.

Ma caro Grande Fardello, ops Fratello, ti diciamo un segreto: l’informazione, per sua natura, è da sempre pericolosa, oscena, violenta, diretta, perché la vita non è un salottino da gossip dove tutto è infiocchettato per lo streaming. Nascondere tutto questo è democratico quanto bruciare i libri per la paura che la cultura possa rendere l’uomo libero, e quindi meno schiavo, anche della tecnologia.